ついに、私たちのポケットの中にあるAIが、言葉や絵だけでなく「音楽」まで奏でる日がやってきました。2026年2月、Googleは生成AI「Gemini」に、最新の音楽生成モデル「Lyria 3」を搭載したことを発表しました。これまで文章や画像の作成で私たちを驚かせてきたGeminiですが、今度は「作曲家」としての顔を見せ始めています。

鼻歌くらいの軽い気持ちでアイデアを投げかけるだけで、本格的な歌入りのトラックが返ってくる。そんな新しい体験が、いま手元のスマートフォンで始まろうとしています。音楽の知識がまったくない人でも、プロデューサーのような気分を味わえるこの新機能について、その仕組みと魅力をわかりやすく解説します。

音声のみはこちら↓

Geminiに音楽生成AI「Lyria 3」が来た

そもそもLyria 3って何?ひとことで理解

Lyria 3(リリア・スリー)とは、GoogleのAI研究部門であるGoogle DeepMindが開発した、最先端の音楽生成AIモデルのことです。これまでもAIによる音楽作りは存在しましたが、Lyria 3の最大の特徴は、その「表現力」と「身近さ」にあります。

これは単なる実験的なツールではなく、私たちが普段使っているGeminiアプリの中に標準機能として組み込まれました。つまり、特別な機材や高価なソフトを買わなくても、チャットで話しかけるような感覚で音楽を作れるようになったのです。Google DeepMindの技術によって、楽器の音色から歌声のニュアンスまで、驚くほどリアルなサウンドを生み出すことが可能になりました。

何が“新しい”のか:画像・動画に続いて音楽が統合されたインパクト

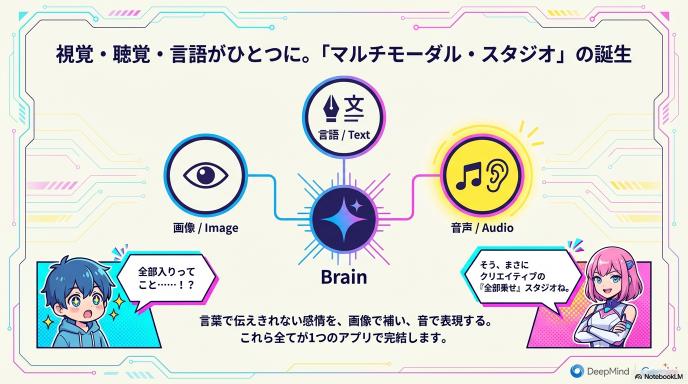

Geminiはこれまで、テキストでの質問回答や、画像の生成、そして動画の作成と、できることを着実に広げてきました。今回、そこに「音楽(オーディオ)」が加わったことは、AIの歴史において非常に大きな意味を持ちます。

私たちが何かを表現したいとき、言葉だけでは伝えきれない感情や雰囲気があります。これまでは画像生成で視覚的なイメージを補ってきましたが、これからはそこに「音」という聴覚の要素も一度に作り出せるようになったのです。目で見えるものと耳で聞こえるものが一つのアプリで完結する、まさに「マルチモーダル(多機能統合)」なクリエイティブスタジオが完成したと言えるでしょう。

Lyria 3でできること(まずここだけ押さえる)

テキストから30秒の楽曲を自動生成(歌詞・ボーカル込み)

Lyria 3の最も基本的で、かつ強力な機能は、言葉による指示だけで最大30秒間の音楽トラックを作れることです。ここで重要なのは、単にピアノやドラムの音が鳴るインストゥルメンタル(歌なし曲)だけではないという点です。

「切ない別れを歌ったバラード」や「金曜日の夜を盛り上げるアップテンポなポップス」といった指示を出せば、AIがその雰囲気に合ったメロディを作曲し、さらに歌詞を書き、それに合った歌声で歌ってくれます。もちろん、自分で考えた歌詞を歌わせることも可能ですし、歌詞が思いつかなければAIにお任せすることもできます。たった30秒ですが、そこには起承転結のあるドラマが凝縮されています。

写真(や動画)の雰囲気から曲と歌詞を作る

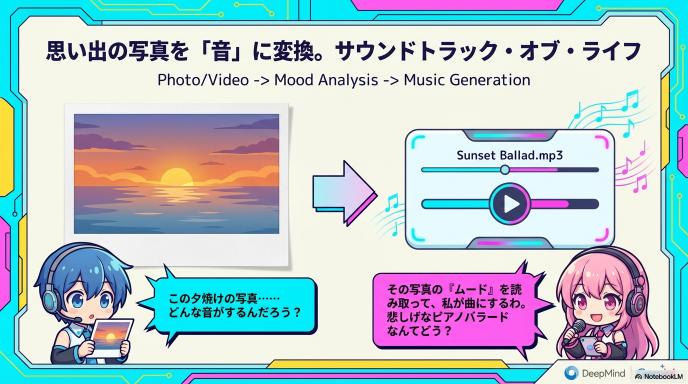

言葉で音楽のイメージを伝えるのが難しいと感じることもあるでしょう。そんな時に活躍するのが、画像や動画を使った生成機能です。たとえば、スマートフォンの中にある「夕焼けの写真」や「友人と笑い合っている動画」をGeminiにアップロードしてみてください。

Lyria 3は、その画像から視覚的な情報だけでなく、そこに漂うムードや感情を読み取ります。そして、「この写真にBGMをつけるならこんな曲」という提案を、歌詞とメロディの形で行ってくれるのです。視覚情報がそのまま聴覚情報へと変換される体験は、まるで自分の思い出が映画のワンシーンになったかのような感動を与えてくれるはずです。

スタイル・テンポ・ボーカルなどを調整できる

AIにお任せで作るだけでなく、ユーザーが細かくこだわりを反映できるのもLyria 3の魅力です。「もう少しテンポを速くして」「ボーカルは女性の声で、少しハスキーに」「80年代のシンセポップ風に」といった具体的なリクエストに応えてくれます。

これは、AIが単にランダムに音を出しているのではなく、音楽の構造やジャンルの特徴を深く学習しているからこそできることです。自分の頭の中で鳴っている漠然としたイメージを、対話を通じて徐々に理想の形へと近づけていく過程は、まさにAIとの「共作」と言えます。

カバーアートまで自動生成される

音楽ができあがったとき、その曲を彩る「ジャケット画像」も欲しくなるものです。Geminiは気が利いていて、生成された楽曲の雰囲気に合わせたカバーアート(アルバムのジャケット画像)も自動で作成してくれます。

これには、同じくGeminiに搭載されている画像生成モデル(Nano Bananaなど)の技術が連携して動いています。完成した作品は、音楽と画像がセットになったMP4形式の動画、または音声のみのMP3形式としてダウンロードできます。そのままSNSでシェアしたくなるような、視覚的にも完成された「作品」として手元に届くのです。

使い方は想像以上にシンプル

音楽制作と聞くと、複雑なソフトウェアを立ち上げて、専門用語と格闘する姿を想像するかもしれません。しかし、Lyria 3を搭載したGeminiでの音楽づくりは、チャットで友人にメッセージを送るのと変わらないくらい簡単です。新しいアプリをインストールする必要すらなく、いつものGeminiがそのままスタジオになります。

Geminiで「Create music」を開く

まずは、スマートフォンやパソコンでGeminiを開いてみてください。これまでのテキスト入力欄の近くに、新しいクリエイティブな選択肢が増えているはずです。具体的には、ツールメニューから「音楽を作成(Create music)」という項目を選ぶか、あるいはもっと直感的に、チャット欄に「曲を作って」と話しかけるだけで準備は完了します。

GoogleのWorkspace更新情報によると、この機能はデスクトップ版から順次展開され、モバイルアプリでも数日のうちに利用可能になるとされています。もしメニューが見当たらない場合は、アプリが最新バージョンになっているか確認してみましょう。特別な機材は一切不要で、タップ一つで世界中の楽器とスタジオ機能にアクセスできるのです。

プロンプト例:コピペで試せるテンプレ集

何と入力すればいいか迷ったら、まずは「動詞」から始めてみるのがおすすめです。Googleのヘルプでは、「write(書いて)」「compose(作曲して)」「create(作って)」といった言葉で書き出すことで、AIが意図を汲み取りやすくなると案内されています。

たとえば、「朝のジョギングに合う、疾走感のあるエレクトロニックな曲を作って」と頼めば、目が覚めるようなビートが返ってきます。あるいは、「雨の日のカフェで流れているような、落ち着いたジャズピアノと女性ボーカルの曲」と伝えれば、しっとりとした雰囲気を演出してくれます。最初は難しく考えず、今の気分や聴きたいシチュエーションをそのまま言葉にするだけで、AIが驚くほど的確なサウンドを返してくれるはずです。

生成した曲の保存・共有(MP3/MP4)と活用シーン

気に入った曲ができたら、それを自分だけのものにしておくのはもったいないですよね。生成された楽曲は、すぐにダウンロードして保存することができます。形式は、音楽として純粋に楽しむための「MP3(音声のみ)」と、自動生成されたカバーアートが動く「MP4(動画)」の2種類から選べます。

これをスマートフォンの着信音に設定したり、自分で撮影したVlog(ビデオブログ)のBGMとして使ったりと、楽しみ方は無限大です。また、生成された結果には共有リンクも発行されるため、SNSで友人に「今の気分を曲にしてみた」とシェアするのも新しいコミュニケーションになるでしょう。著作権を気にせず使えるオリジナルの30秒トラックは、クリエイターにとっても強力な武器になります。

いい感じの曲を出すコツ(プロンプト設計の基本)

適当に入力してもそれなりの曲はできますが、少し言葉を選ぶだけでクオリティが劇的に上がります。AIは魔法の杖ですが、その杖を振るための「呪文(プロンプト)」が具体的であればあるほど、想像通りの魔法がかかるのです。

指定すると強い要素:ジャンル・ムード・BPM・楽器

AIに「どんな曲?」と聞かれたとき、真っ先に伝えたいのが「ジャンル」と「雰囲気」です。「ロック」だけではなく「90年代のオルタナティブ・ロック」や、「ポップス」ではなく「夏のドライブで聴きたいシティポップ」のように、時代やシチュエーションを足すと解像度が上がります。

さらにこだわりたいなら、楽器を指定してみましょう。「歪んだベース音を入れて」とか「サックスのソロを際立たせて」といった具体的な指示もLyria 3は理解します。また、曲の速さを決める「テンポ(BPM)」や、「リズム感(アップビート、スローバラードなど)」を指定することで、曲のノリを完全にコントロールできるようになります。

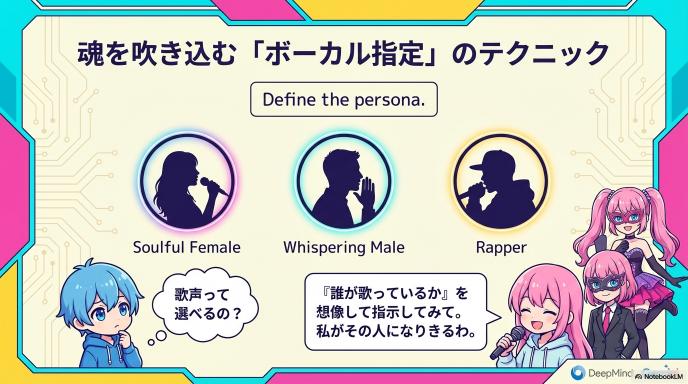

“ボーカル像”を言語化すると一気にそれっぽくなる

Lyria 3の凄みは、なんといっても「歌声」の生成能力にあります。ここでプロっぽさを出すコツは、ボーカルのキャラクターを指定することです。単に「歌入りで」とするよりも、「力強いソウルフルな女性ボーカルで」とか、「ささやくような男性の低音ボイスで」と指定すると、曲に魂が宿ります。

声の質だけでなく、「コーラスを入れて」や「ラップパートを含めて」といった構成の指示も可能です。ボーカルのイメージが具体的であればあるほど、AIは迷わずに最適な声色を選び出し、まるで実在する歌手が歌っているかのようなリアリティを生み出してくれます。

歌詞を任せる/自分で寄せる:使い分けの考え方

歌詞については、2つのアプローチがあります。一つは「テーマだけ伝えてAIに任せる」方法です。「失恋して悲しいけど前を向く歌詞」と伝えれば、AIが文脈を読んで韻を踏んだ歌詞を自動で作ってくれます。これはアイデアが欲しいときに最適です。

もう一つは「自分で書いた歌詞を歌わせる」方法です。あらかじめ用意したテキストをプロンプトに貼り付ければ、その言葉通りに歌ってくれます。ただし、30秒という短い尺に収める必要があるため、あまり長文すぎると早口になったり入りきらなかったりします。サビのワンフレーズや、伝えたいメッセージを短くまとめるのが、綺麗な曲に仕上げるコツです。

写真入力でハズレを減らすポイント

写真や動画から曲を作る場合、AIは画像の中の「色合い」や「被写体」から勝手に雰囲気を読み取ります。たとえば、青い海の写真なら爽やかな曲になりやすいですが、もし「海だけど、嵐の前の不穏な感じにしたい」という場合は、画像だけでなくテキストで補足説明を加えるのが重要です。

「この写真の雰囲気で、ただし曲調は悲しげなピアノバラードにして」といった具合に、視覚情報(画像)と指示(テキスト)を組み合わせることで、AIの解釈ミスを防ぐことができます。画像はあくまでインスピレーションの種として使い、具体的な方向性は言葉でハンドルを切ってあげる。これが、マルチモーダル機能を使いこなす一番の秘訣です。

「アーティスト名指定」はどこまでOK?著作権・安全面

音楽を作るとなると、どうしても「あのアーティストみたいな曲にしたい!」という憧れが出てくるものです。しかし、そこで気になるのが著作権や、「本人の声を勝手に使っていいのか?」という問題です。Lyria 3は、クリエイティビティを最大限に引き出しつつ、アーティストの権利を守るために、非常に慎重なルールの上で設計されています。

公式が言う「似た雰囲気」と「模倣」の線引き

Geminiのプロンプト入力欄に、有名なアーティストの名前を入れて曲を作ろうとするとどうなるのでしょうか。Googleの公式ブログによると、アーティスト名が含まれるプロンプトは、その特定の歌手の声をそのまま再現する(ディープフェイクを作る)ための指示としては扱われません。あくまでも「そのアーティストが持っている音楽的なスタイルやムード」を参照するためのヒントとして処理されます。

つまり、「〇〇風の曲」と頼んでも、本人そっくりの声で歌い出すわけではありません。AIは「このユーザーは、ロックでハスキーな感じが好きなんだな」とか「アコースティックで優しい雰囲気を求めているんだな」と解釈し、オリジナルの歌声とメロディで出力します。これは、既存の楽曲をコピーするのではなく、新しい作品を生み出すための「インスピレーション」として名前を使うという考え方に基づいています。

フィルタと報告導線:権利侵害への対策はどうなっている?

もちろん、いくらスタイルを真似るだけと言っても、偶然似すぎてしまうリスクはゼロではありません。そこでGoogleは、生成された楽曲が既存の著作権で保護されたコンテンツと過度に類似していないかをチェックする強力なフィルタ機能を導入しています。このフィルタが「これは既存のヒット曲に似すぎている」と判断した場合、生成はブロックされる仕組みになっています。

また、万が一権利を侵害していると思われるコンテンツが生成されてしまった場合に備えて、ユーザーや権利者が問題を報告できる専用のフォームも用意されています。技術的なガードレールだけでなく、人間によるチェックの仕組みも整えることで、クリエイターとアーティストの双方が安心して使える環境を目指しています。

SynthIDとは:AI生成の“透かし”で何が変わる?

AIで作った音楽が、人間が作ったものと区別がつかなくなると、「誰が作ったのか」という証明が難しくなります。この問題を解決するために導入されたのが、Google DeepMindが開発した電子透かし技術「SynthID(シンスアイディー)」です。これは、生成された音声データの中に、人間の耳には絶対に聞こえない特殊な信号(透かし)を埋め込む技術です。

この透かしは非常に強力で、MP3に圧縮したり、音量を上げ下げしたり、ノイズを加えたりしても消えることはありません。専用のツールを使えば、「この曲はGoogleのAIで作られたものである」ということが瞬時に判別できます。これにより、AI生成物が「人間が作った新曲」として偽って流通するのを防ぎ、透明性を保つことができるのです。高校生のみなさんが将来クリエイターになったとき、この技術が自分の作品を守る盾になるかもしれません。

Suno/Udioはどうなる?“専用サービス”と“統合型”の違い

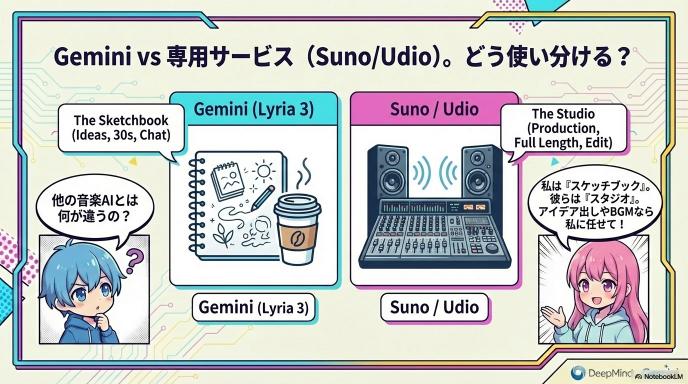

音楽生成AIの世界には、すでに「Suno」や「Udio」といった強力なライバルが存在しています。これらは音楽を作ることに特化した専用サービスとして人気を集めていますが、今回登場したGemini(Lyria 3)はそれらと何が違うのでしょうか。それぞれの強みを知れば、自分の目的に合わせて使い分ける賢いクリエイターになれます。

Geminiの強み:チャットからそのまま曲が作れる導線

Geminiの最大の武器は、その「手軽さ」と「統合体験」にあります。これまでは、文章を書くときはチャットAI、音楽を作るときは音楽生成サイト、とアプリを行ったり来たりする必要がありました。しかしGeminiなら、友達とチャットをするような感覚で、文章の相談をしている流れのまま「じゃあ、今の話に合う曲も作って」と頼むことができます。

日常のあらゆる作業の中に、自然と音楽制作が溶け込んでくるこの体験は、他の専用サービスにはない魅力です。宿題の休憩中にBGMを作ったり、プレゼン資料に添えるちょっとしたサウンドを作ったりするなら、圧倒的にGeminiの方がスムーズでしょう。

専用サービスの強み:長尺・編集・ワークフローの深さ

一方で、SunoやUdioといった先行する専用サービスには、「音楽制作ツール」としての深みがあります。Geminiが現状30秒の生成にとどまるのに対し、専用サービスでは数分間のフルコーラスを作れたり、気に入らない部分だけを作り直したりといった細かい編集機能が充実しています。

「ちょっとしたBGM」ではなく、「作品として完結した楽曲」を作り込みたい場合や、アルバムを作って配信したいといった本格的な用途では、まだ専用サービスに軍配が上がります。彼らはプロの作曲家も使うような「スタジオ」を目指しており、Geminiは誰でも使える「スケッチブック」である、という住み分けができています。

これからの勝負軸:機能より“制作体験”が決める

これからのAI音楽の進化は、「どれだけリアルな音が作れるか」という音質の競争から、「どれだけ楽しく、思い通りに作れるか」という体験の競争に移っていくでしょう。Geminiが画像や動画、そして音楽を一つのチャット画面で扱えるようになったことで、「クリエイティブのすべてをAIと相談しながら作る」という新しいスタイルが定着しそうです。

将来的には、Geminiで作った30秒のアイデアを、専用サービスに持ち込んでフル尺に仕上げるといった連携も生まれるかもしれません。どちらが優れているかではなく、自分のアイデアを形にするために、どの道具をどう組み合わせるか。その選択肢が増えたことこそが、私たちにとって一番のニュースなのです。

Lyriaファミリーの全体像(知っておくと理解が深まる)

「Lyria 3」という名前を聞いて、「3があるなら1や2はどうなったの?」と思った鋭い人もいるかもしれません。実はLyria(リリア)というのは、Google DeepMindが開発している音楽生成技術の大きなファミリー名です。今回Geminiに搭載されたのはその中の一つに過ぎません。この全体像を知ることで、Googleが音楽AIで何を目指しているのかがより深く見えてきます。

Lyria 3:一般ユーザー向けの30秒生成体験

私たちが今、手元のスマートフォンで触れることができるのが、この「Lyria 3」です。Geminiアプリの中に組み込まれており、誰でも簡単に、高品質な音楽トラックを作れるように設計されています。

最大の特徴は、「30秒」という短い時間の中に、歌、歌詞、伴奏、そしてカバーアートまでを一つのパッケージとして完成させる点です。SNSでの共有や、ちょっとした動画のBGM作成に特化した、いわば「インスタント・カメラ」のような手軽さと完成度の高さを持っています。複雑な操作はいらず、出来上がったものをすぐに楽しめるのがこのモデルの役割です。

Lyria RealTime:リアルタイム生成という別方向の進化

一方で、研究室や一部の実験機能として存在するのが「Lyria RealTime」です。こちらは「完成品を出力して終わり」ではありません。「流れている音楽をリアルタイムに操縦する」という、全く別の体験を提供します。

音楽を止めることなく、再生しながらテンポを変えたり、楽器を足したり、曲の展開を変えたりできるのです。まるでDJがその場で即興演奏をするような感覚で、終わりなく続く音楽ストリームを生成し続けることができます。これはYouTubeショート向けの「Dream Track」などの実験機能の裏側で動いている技術とも関連しており、未来のライブパフォーマンスの形を変えるかもしれません。

Vertex AI:企業・開発者向けの音楽生成APIの位置づけ

そして、さらに舞台裏には「Vertex AI(バーテックス・エーアイ)」上のLyriaモデルが存在します。これは一般ユーザー向けではなく、プロのエンジニアや企業が使うためのツールです。

例えば、「自社のゲームアプリの中で、プレイヤーの行動に合わせて音楽が自動で変わる機能をつけたい」といった場合に、企業はこのAPIを使ってシステムを開発します。Geminiが完成された料理を提供するレストランだとしたら、Vertex AIはプロのシェフが食材を仕入れるための市場のような場所です。ここではより細かい制御や、大規模な商用利用を前提とした設計がなされています。

まとめ:Lyria 3で変わる“音楽の作り方”と次の注目ポイント

音楽を作ることは、長い間「選ばれた人」だけの特権でした。楽器が弾ける、楽譜が読める、高価な機材を持っている……そんな壁が、Lyria 3の登場によって一気に低くなりました。言葉や写真ひとつで、誰でも自分の感情を「音」として表現できる時代の幕開けです。

まず試すならここ:初心者向け最短ルート

ここまで読んで「やってみたい!」と思ったなら、まずは難しく考えずにGeminiアプリを開いてみましょう。そして、シンプルな言葉を投げかけてみてください。

おすすめのスタート地点は、「Lo-fi hip hop beat for studying(勉強のためのローファイ・ヒップホップ)」や「Epic movie soundtrack(壮大な映画のサントラ)」といった、定番のジャンルを指定することです。これだけで、数秒後には世界に一つだけの曲があなたの手元に届きます。もし気に入らなければ、「もっと明るく」「ドラムを激しく」とチャットで言い直せばいいだけです。この「AIと対話しながら作る」楽しさを、ぜひ最初に味わってください。

今後のアップデートで見たい点(尺・編集・言語・商用周り)

もちろん、まだ完璧ではありません。現状の30秒という制限は、本格的な曲作りには少し物足りないかもしれません。「Aメロは良かったけどサビだけ直したい」といった部分的な修正機能(インペインティング)や、生成した曲をSpotifyなどで配信して収益化するための明確な商用ライセンスなど、ユーザーが期待する機能はまだまだあります。

また、日本語の歌詞のイントネーションがより自然になることや、対応言語がさらに増えていくことも期待されます。Geminiは日々進化しています。今日できないことが、来月には当たり前になっているかもしれません。その進化の過程を、ぜひリアルタイムで追いかけてみてください。

コメント