X(旧Twitter)で利用できるAI「Grok」。その中でも、テキストや画像から動画を作り出す「Grok Imagine」の進化が今、とんでもないスピードで進んでいます。

「AIで動画を作れるのは知っているけど、数秒でぐちゃぐちゃに崩れるオモチャでしょ?」と思っているなら、その認識はアップデートが必要です。最近の機能追加により、Grok Imagineは「AIの機嫌ガチャ」から、「人間が狙った通りに映像を操るためのツール」へと変貌を遂げつつあります。

この記事では、Grok Imagineに最近追加された強力な新機能の解説から、絶対に失敗しないためのプロンプト(指示)の出し方、そして多くの人が気になっている「結局、長い動画は作れるの?」「キャラクターの声は統一できるの?」といったリアルな仕様と限界まで、実務で使えるレベルの徹底的な解説書としてお届けします。

音声のみはこちら↓

Grok Imagineに新機能が続々追加、何が変わったのか

これまでの動画生成AIの最大の弱点は「コントロールが効かないこと」でした。プロンプトを入れても、AIが勝手に解釈して予想外の映像を出してくるため、運任せの要素が非常に強かったのです。しかし、最近のGrok Imagineのアップデートは、この「コントロール性」を劇的に引き上げるものになっています。

最近注目されている新機能は大きく4つ

現在、SNSの検証報告や実務クリエイターの間で特に話題になっている新機能は、大きく分けて以下の4系統に分類されます。

- Extend from Frame(動画の途中から続きを作る機能)

- フォルダ管理(画像・動画の整理機能)

- 複数画像リファレンス(複数の参考画像で一貫性を出す機能)

- 「@」画像指定編集(特定の画像を呼び出して編集する機能)

これらが組み合わさることで、これまで「無理だ」と思われていた複雑な映像表現が、一気に現実的なものになりました。

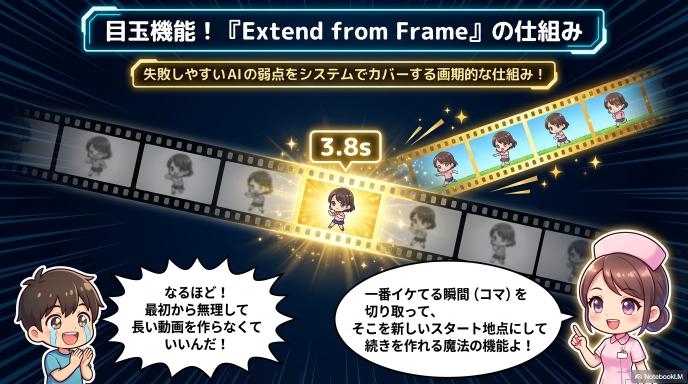

特に話題なのは「Extend from Frame」

この4つの中で、間違いなく今の目玉機能と言えるのが「Extend from Frame」です。 AI動画を作っていると、「最初の3秒は完璧だったのに、4秒目から急にキャラクターの顔が崩れてクリーチャーになってしまった」という経験が必ずあるはずです。この機能は、そんな時に「完璧だった3秒目」の瞬間を切り取り、そこを新しいスタート地点にして続きを作り直すことができます。動画の「一番いいところ」だけをつないでいける、魔法のような機能です。

クリエイター目線で便利になったのは管理機能と参照機能

派手さはないものの、実際に動画を作り込む人にとって「これが欲しかった!」と絶賛されているのが、フォルダ管理と複数画像リファレンスです。 1日に何十本も生成テストを繰り返す実務において、AI動画の最大のボトルネックは「作ること」ではなく、「過去に作った良い素材を探し出せないこと」でした。これらを整理し、さらに「この顔と、この服で」と細かく指定できるようになったことで、Grokは遊びのツールから実用的なクリエイティブツールへと進化しています。

Grok Imagineの主な新機能まとめ

それでは、先ほど挙げた4つの新機能について、一つずつ「具体的にどんな機能なのか」「何がすごいのか」を高校生にもわかるように紐解いていきます。

Extend from Frameとは何か

直訳すると「フレーム(コマ)からの延長」です。生成した動画のタイムライン上で、好きな瞬間の1コマを選び、そこから先の映像を新しく作り出す機能です。 要するに、「6秒の動画を作る → 3.8秒の地点の映像が一番綺麗だったのでそこを選ぶ → そこを起点に、さらに続きの数秒を作る」という流れで動画を伸ばしていくことができます。最初から長い動画を作ろうとすると失敗しやすいAIの弱点を、システム側でうまくカバーした画期的な仕組みです。

生成した画像・動画をフォルダで整理できる機能

生成した大量の素材を、自分で作ったフォルダに分けて保存できる機能です。 「案件別」「キャラクター別」「企画別」「納品候補」など、パソコンのファイル管理と同じように整理できます。同じプロンプトから派生した数十パターンの動画を「01_元ネタ」「02_延長版」のようにバージョン管理できるため、作業効率が圧倒的に上がります。

複数画像リファレンスで一貫性を出しやすくなった

AIに参考画像(リファレンス)を読み込ませる際、1枚だけでなく複数枚(最大7枚という報告もあります)を同時に読み込ませて指示を出せる機能です。 これまでは1枚のイラストを入れて「これを動かして」と指示していましたが、それだと背景や服がうまく再現されませんでした。この機能を使えば、「画像1はキャラクターの顔」「画像2は着せたい服」「画像3は立たせたい背景の場所」というように、AIに対して「役割」を分けて学習させることができ、世界観の整合性が格段にアップします。

「@」で画像を呼び出して指示する編集フローとは

チャットの入力欄で「@画像の名前」と打ち込むことで、参照したい特定の画像を明示的に指定し、それに対して編集指示を出せる機能です。 AIは文脈を読むのが苦手な時があり、ただ「帽子をかぶせて」と言うと、画面全体の雰囲気を変えてしまうことがあります。しかし「@元の動画 5秒後に頭に帽子を載せる」と指示することで、「何を」「いつ」「どう変えるか」という曖昧さのない明確な命令が可能になります。

Extend from Frameでできること

新機能の仕組みがわかったところで、特に強力な「Extend from Frame」を使うと、具体的にどんな面白いこと・便利なことができるのかをまとめました。

動画の好きな場面から続きを生成できる

短い動画を1本生成し、その中でキャラクターが最も美しく描かれている瞬間や、動きがピタッと止まって安定している瞬間を狙い撃ちして、そこから自然な続きの動きを作り出すことができます。

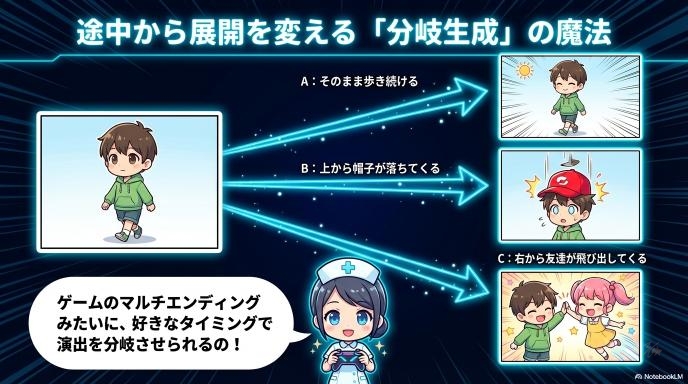

途中から展開を変える“分岐生成”ができる

ゲームのマルチエンディングのように、同じ1つの動画から別の展開を作ることができます。 例えば「キャラクターが歩いている動画」の途中から、「A:そのまま歩き続ける展開」「B:突然上から帽子が落ちてくる展開」「C:画面の右から別のキャラクターが飛び出してくる展開」のように、好きなタイミングで演出を分岐させることが可能です。

短尺クリップを積み重ねて長く見せる使い方に向いている

AIの動画生成は、長ければ長いほど映像が破綻しやすくなります。しかし、この機能を使えば「安定している最初の数秒」+「そこから延長した安定している数秒」+「さらに延長した数秒」というように、破綻していない綺麗な短いブロック(クリップ)だけを積み重ねて、結果的に長い映像を作り上げることができます。

SNS動画・Bロール・プレゼン用素材との相性がいい

TikTokやYouTubeのショート動画のように、次々と場面が切り替わるテンポの速い動画と非常に相性が良いです。また、YouTuberの動画の間に差し込まれるイメージ映像(Bロール)や、学校のプレゼン資料の背景で流しておくような「ちょっとした高品質なループ動画」を作るのにも、この機能は威力を発揮します。

Grok Imagineの使い方の基本フロー

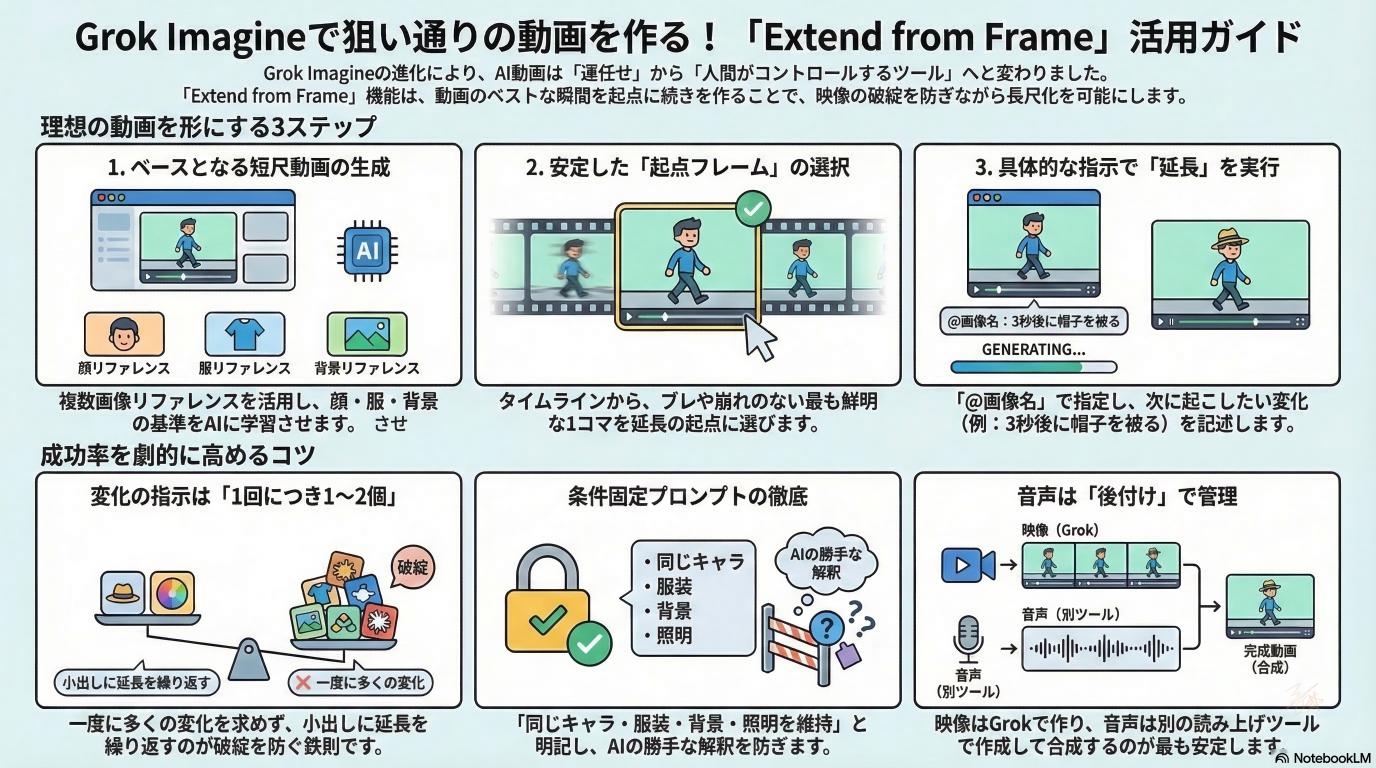

新機能を使いこなすための、実際の作業手順です。「Extend from Frame(フレーム延長)」や「複数画像リファレンス」を組み合わせた、最も失敗しにくい王道のフローを紹介します。

まずは短い元動画を生成する

いきなり複雑な指示を出して長い動画を作ろうとするのはNGです。まずはベースとなる数秒の短い動画を作ります。この時、複数画像リファレンスを使って、顔・服・背景の「基準」をしっかりAIに認識させておくのがポイントです。

タイムラインで延長したいフレームを選ぶ

出来上がった短い動画を再生し、「ここだ!」という瞬間(フレーム)を選びます。「Extend / Continue / Extend from Frame」といったボタンを押し、そのコマを次の起点としてセットします。

追加したい動きや演出をプロンプトで指示する

選んだフレームに対して、「ここからどうしたいか」をテキスト(プロンプト)で書きます。「5秒後に帽子を載せる」「右から別キャラを入れる」など、次に起こしたいアクションを具体的に指示します。

良いカットを起点に再延長していく

新しい動画が出力されたら確認します。もし綺麗に繋がっていたら、またその動画の安定したフレームを選び、さらに延長を繰り返します。少しずつ、ブロックを繋げるように動画を伸ばしていきます。

生成物をフォルダで整理しながら管理する

動画を伸ばしていくと、「どれが最新バージョンか」「どれが失敗作か」がすぐに分からなくなります。作業と並行して「01_元動画」「02_延長1回目」「03_完成候補」のようにフォルダに分けて管理する癖をつけましょう。

うまく使うためのコツとテクニック

AIは指示通りに動くとは限りません。思った通りの映像を出す(成功率を上げる)ための、プロのテクニックをまとめました。

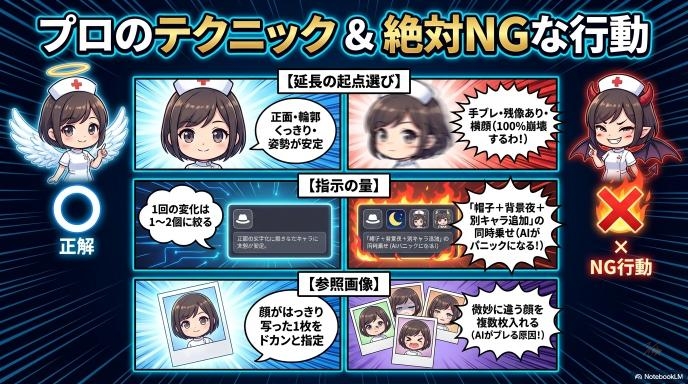

延長の起点は“ブレていない安定フレーム”を選ぶ

これが一番重要です。延長のスタート地点にするコマが「手ブレしている」「顔が横を向いて崩れかけている」「動きが速くて残像が出ている」状態だと、そこから作られる続きの映像は100%崩壊します。必ず「正面顔・輪郭がくっきり・姿勢が安定している瞬間」を選んでください。

1回の延長で指示する変化は1〜2個に絞る

「帽子をかぶせて、カメラを回して、背景を夜にして、別のキャラを出して!」と一度に指示を詰め込むとAIはパニックになります。「まずは帽子をかぶせる動画を作る」→「成功したら、それを起点に別キャラを出す」というように、変化は小出しにするのが鉄則です。

「同じキャラ・同じ背景・同じライティング」を明記する

AIは「帽子をかぶせて」と言われると、気を利かせて勝手に服や背景まで変えてしまうことがあります。これを防ぐため、プロンプトには「同じキャラクター、同じ服装、同じ背景、同じライティングを維持」という条件を必ず書き込んでください。

変化のタイミングは秒数や位置で具体的に書く

単に「キャラを出す」より、「2秒後に(After 2 seconds)」「画面の右側から(from the right edge)」のように、いつ・どこで変化が起きるのかを具体的に書いたほうが、AIは迷わずに映像を作れます。

複数画像リファレンスは役割を分けて使う

参考画像は「画像1は顔の基準」「画像2は衣装」「画像3は小物」「画像4は背景」といったように、役割をハッキリ分けて読み込ませましょう。役割が被るとAIが迷います。

顔・衣装・背景・小物の参照を混ぜすぎない

同じキャラクターの微妙に違う画像を何枚も入れるのは逆効果です。「どれが正解の顔なの?」とAIがブレてしまいます。顔を似せたいなら「顔が大きくはっきり写っている画像」を1枚だけドカンと入れる方が効果的です。

実際に試したいプロンプトの考え方

そのままコピペして使える、実務で通りやすいプロンプト(指示文)の型を紹介します。英語の方が指示が通りやすいため、英語例も併記します。

途中で帽子や小物を追加するパターン

上から物が落ちてくるような動きは、AIが比較的得意な表現です。

- 日本語例: 同じキャラクター、同じ服装、同じ背景、同じライティングを維持。カメラは固定。3秒後、上から自然に赤い帽子が現れ、キャラクターの頭にやさしく載る。動きは滑らかで、違和感なく続く。

- 英語例: Keep the same character, outfit, background, and lighting. Static camera. After 3 seconds, a red hat gently lands on the character’s head. Smooth natural motion, seamless continuation.

別キャラを途中からフレームインさせるパターン

ミーム動画や掛け合いを作りたい時に便利です。カメラは動かさないのがコツです。

- 英語例: Keep the first character consistent. Static camera, same background and lighting. After 2 seconds, a second character enters from the right side of the frame and stands next to the first character. Natural motion, no sudden camera change.

静かな導入から少しずつ動きを足すパターン

最初はほとんど動かない状態(止め絵)を作り、まずは映像を安定させます。そこからフレーム延長を使って、振り向きや歩き出しなどの動きを少しずつ足していくと破綻が少ないです。

Bロール風に自然な動きだけを延長するパターン

風景や作業シーンなど、大きな変化を起こさずにゆっくりとした動きを長く見せたいパターンの書き方です。

- 英語例: Continue the scene seamlessly. Slow cinematic motion, stable composition, soft natural movement. No dramatic scene change. Maintain the same subject identity and visual style.

サブスクで何が変わるのか

「Grokは無料で使えるの? 有料プランにすると画質が良くなるの?」という疑問について、リアルな現状を整理します。

有料プランは利用上限が上がる可能性が高い

公式の案内で最も確実なのがこれです。無料版(または下位プラン)だと、数回作っただけで「今日の制限です」と止められてしまいますが、Premiumなどの有料プランにすると生成できる回数(上限)が大幅に増えます。

新機能が先行して使えるケースがある

上位プラン(Premium+など)では、「新しい機能がいち早く使える(先行アクセス)」というメリットが公式で案内されています。

高画質化は期待できるが、公開情報では条件が変動しやすい

SNSでは「無料は480pで6秒、有料は720pで長くなる」といった情報が飛び交いますが、公式のヘルプに「〇〇プランなら絶対にこの画質」と固定の数値が書かれているわけではありません。アップデートや混雑状況で変わりやすいため、「そういう傾向はある」くらいに捉えておくのが安全です。

無料版と有料版の違いは“回数・優先度・機能開放”で見ると分かりやすい

AI動画は「失敗してやり直す」のが前提のツールです。そのため、「課金すれば絶対に綺麗な動画が一発で出る」のではなく、「制限が緩くなって何度もリトライできるから、結果的に良い動画を作りやすくなる」と考えるのが一番正確です。

長尺動画は作れるのか

「AIで30分のアニメを自動で作りたい!」と思っている方には厳しい現実ですが、今の技術レベルを正直に解説します。

1本で長く作るより、短尺をつないで伸ばす発想が前提

Grokの公式の仕様上も、一回の生成でいきなり30秒の完璧な動画を作るようには設計されていません。「数秒の動画を作る」機能と「それを編集して引き継ぐ」機能の組み合わせが基本です。

Extendを繰り返して擬似的に長尺化するのは現実的

先ほど解説した「Extend from Frame」を使って、「6秒作る」→「そこからまた6秒足す」を繰り返せば、映像自体を長くしていくことは十分に可能です。

長くするほど破綻しやすいので、安定区間を切り出して再利用する

AIは動画が長くなるほど、少しずつ顔が崩れたり、背景が歪んだりする「幻覚」を起こします。そのため、毎回「一番安定している数秒間」だけを切り出して、そこを次の起点にする堅実な作業が必要です。

30秒級を狙うなら“連続生成”ではなく“連結設計”が重要

最終的に長い動画を作りたいなら、Grokの中だけで完結させようとせず、短い良質なクリップをたくさん作り、動画編集ソフト(Premiere ProやCapCutなど)に持っていって繋ぎ合わせる「連結設計」が必須です。

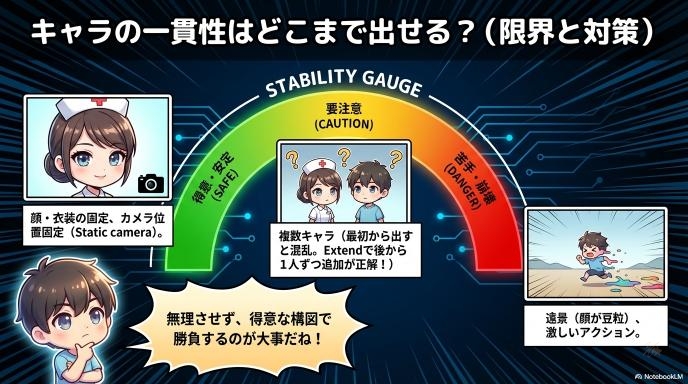

キャラの一貫性はどこまで出せるのか

動画の途中でキャラクターの顔が変わってしまう問題への対策です。

映像の一貫性は参照画像と条件固定でかなり改善できる

これまでは運任せでしたが、「複数画像リファレンス」の登場で、キャラクターの顔や服のデザインをかなり固定できるようになりました。

顔・衣装・背景・カメラ条件を固定すると成功率が上がる

プロンプトで「同じカメラ位置(Static camera)」「同じライティング」と条件をガチガチに固定すればするほど、AIが勝手な解釈をする余地が減り、キャラクターの顔は崩れにくくなります。

激しい動きや遠景では崩れやすい

とはいえ限界はあります。カメラから遠く離れて顔が豆粒のようになったり、激しいアクションをさせたり、真横を向いたりすると、まだ顔が崩れやすい傾向にあります。

複数キャラ構成は段階的に増やしたほうが安定する

最初から「画面に3人いて、それぞれ違う服を着ている」という指示を出すとAIは混乱します。まずは主役1人を安定させて作り、Extend機能を使って後から2人目をフレームインさせる方が圧倒的に成功率が高いです。

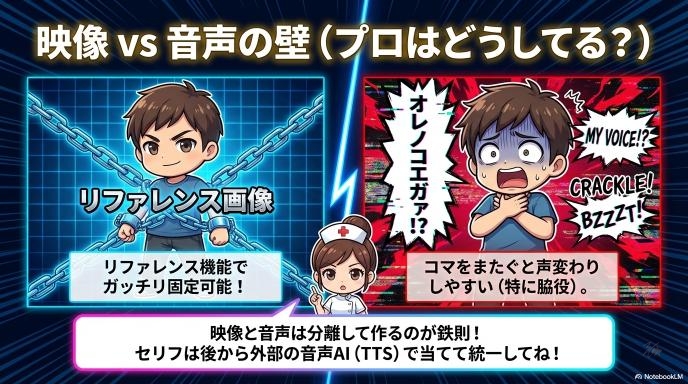

音声の統一は可能なのか

キャラクターが喋る動画を作る際、映像以上に厄介なのが「声」の問題です。

映像の一貫性に比べると、音声の統一はまだ難しい

映像はリファレンスで固定できるようになりましたが、「Grok Imagineで動画を作る際、ネイティブ(自動)で付いてくる声」をキャラクターごとに完全に固定する機能は、まだ弱いです。

特に脇役の声はカットをまたぐとぶれやすい

動画を延長したり、新しいカットを作るたびに、同じキャラクターなのに声質が変わってしまったり、喋り方のテンションが突然変わってしまうことがよく起きます。

ネイティブ音声に任せるより、後付け音声のほうが安定しやすい

現状の公開仕様では、Grok Imagineの中で「このキャラはこの声」と厳密にロックする仕組みは見当たりません。AIのおまかせ音声に頼るのはリスクが高いです。

長尺作品ほど“映像と音声を分離して作る”考え方が有効

ちゃんとした作品を作りたいなら、映像と音声は完全に別々のシステムで作るのが正解です。映像は映像で作る、声は声で作る、という割り切りが必要です。

長尺作品を作るならおすすめの運用方法

これまでの制限を踏まえ、Grokを使って長い動画作品(アニメ風動画や解説動画など)を作る際の、一番堅実なプロのワークフローを紹介します。

映像は短尺ごとに生成してつなぐ

映像はGrok Imagineを使い、無音(または声に依存しない形)で短いクリップを量産し、後で編集ソフトでつなぎます。

セリフは後から同じ音声設定で当てる

音声は、xAIが提供している音声読み上げ(Text to Speech)機能などを使い、特定のボイス(eve、araなど)を指定して作ります。これを後から映像に被せます。

主役・脇役ごとに音声ルールを固定する

「主役の声はara」「脇役Aの声はrex」と配役表をあらかじめ決めておき、毎回同じ設定で音声だけを生成すれば、カットが変わっても声がブレることは絶対にありません。

管理はフォルダ分けと命名ルールで破綻を防ぐ

「projectA_scene03_hat_v04」のように、「どのプロジェクトの」「どのシーンの」「第何バージョンか」がパッと見てわかるファイル名をつけ、フォルダで徹底的に管理することが、長尺動画を破綻させずに完成させる最大のカギです。

Grok Imagineはどんな人に向いているか

今のGrok Imagineが、どんな用途やどんな人にピッタリなのかをまとめました。

SNSショートを量産したい人

TikTokやYouTubeショートのような、数秒ごとに展開が変わるテンポの速い動画を作りたい人には、「Extend from Frame」による分岐生成が最強の武器になります。

キャラ動画やMV風カットを作りたい人

複数画像リファレンスでキャラクターのデザインを固定できるため、音楽に合わせて短いカットを次々とつないでいくミュージックビデオ風の映像作りに非常に向いています。

撮影なしでプレゼン・広告素材を作りたい人

商品画像などを読み込ませて、カメラがゆっくり近づいていくような高品質なイメージ映像(Bロール)を作るのにも最適です。スマホやカメラでわざわざ撮影する手間が省けます。

一方で、長編アニメの完全自動制作にはまだ工夫が必要

「プロンプトを1行書けば、30分のアニメが声付きで全部完成する」という魔法のようなレベルにはまだ達していません。短い素材を作り、人間が監督となってつなぎ合わせる工夫がまだまだ必要です。

現時点での結論

最後に、今のGrok Imagineの新機能を使い倒すための結論をまとめます。

Grok Imagineは“短尺をつないで伸ばす”運用で真価を発揮する

一発で長い名作を作ろうとするのはやめましょう。短い良質なブロックを作り、それを組み立てていく思考に切り替えるのが正解です。

Extend from Frameはかなり実用的な進化

「動画の途中から、好きなタイミングで展開を操れる」というのは、動画生成AIにおける革命的な進化です。これだけでも実務で使う価値は十分にあります。

一貫性は映像のほうが取りやすく、音声は別管理が現実的

顔や世界観はかなり固定できるようになりましたが、キャラクターの声はまだまだブレます。セリフは別の音声AIで作って、後から被せるのが一番クオリティが高くなります。

新機能を活かす鍵は、参照設計と分割生成にある

画像を適切に参照させて基準を作り、短いフレームごとに分割して生成・延長を繰り返す。この仕組みさえ理解すれば、あなたもGrok Imagineを使ってプロ並みの映像を作り出せるはずです。

コメント