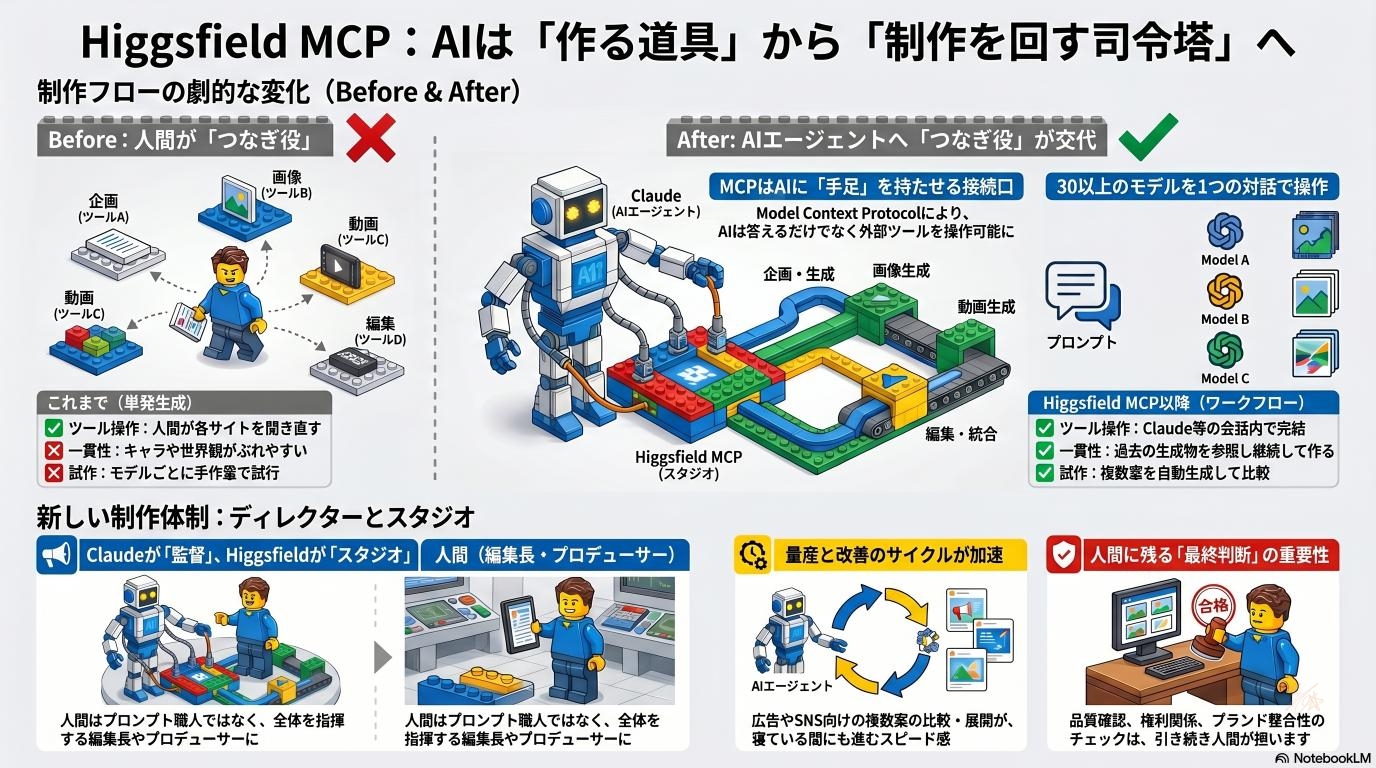

変わるのか。“AIに作らせる”から“AIが制作を回す”時代へ

AIで画像や動画を作ることは、もう珍しくありません。

プロンプトを入れれば画像が出る。

文章を入れれば動画が出る。

写真を渡せば、それらしい広告素材や映像のラフが作れる。

ここ1〜2年で、生成AIは一気に身近になりました。

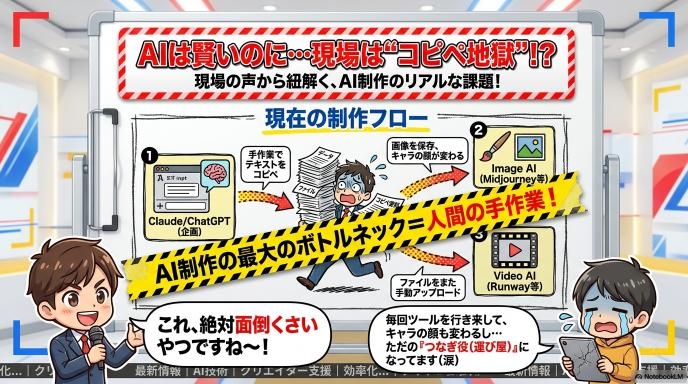

ただ、実際に仕事や制作で使おうとすると、まだ面倒なことも多く残っています。

企画はChatGPTやClaudeで考える。

画像は別の生成AIで作る。

動画はまた別のサービスを開く。

キャラクターの見た目を合わせるために、前回の画像を探す。

モデルごとの違いを見るために、同じプロンプトを何度もコピペする。

できた素材を保存し、またAIに戻って次の指示を出す。

つまり、AIは賢くなったのに、制作の現場ではまだ人間が“つなぎ役”をしていました。

そこに出てきたのが、Higgsfield MCPです。

Higgsfield公式ページでは、Claude、Claude Code、OpenClaw、Hermes Agent、NemoClawなどのMCP対応エージェントから、Higgsfieldの画像生成、動画生成、キャラクター学習、生成履歴の参照などを直接使えると説明されています。

これは単なる「新しいAI動画ツールが出た」という話ではありません。

より正確に言えば、AIが制作ツールを直接動かせるようになる話です。

“すごいモデルが増えた”より、“制作の入口が変わった”ことが大きい

Higgsfield MCPが話題になっている理由は、使えるモデルの数だけではありません。

もちろん、30以上の画像・動画モデルにアクセスできることは大きなインパクトがあります。画像生成AIや動画生成AIを使っている人にとって、複数のモデルをひとつの場所から扱えるのは魅力的です。

ただ、本当に大きいのはそこではありません。

これまでのAI制作では、AIに企画を考えさせたあと、実際に画像や動画を作る段階では人間が別ツールを開く必要がありました。

Higgsfield MCPで変わるのは、この“制作の入口”です。

AIがアイデアを出すだけでなく、そのまま制作ツールを呼び出して、画像や動画の生成まで進められるようになる。

ここに、今回のニュースの本質があります。

これまでは、人間がツール同士をつないでいた

これまでのAI制作では、AIと制作ツールの間に必ず人間が入っていました。

たとえば、Claudeに広告案を考えさせる。

その案をコピーして、画像生成AIに貼り付ける。

画像ができたら、今度は動画生成AIに移動する。

生成結果を見て、またClaudeに戻って改善案を聞く。

この流れは、使える人にとっては強力です。

しかし同時に、手間も多い。

サービスを行き来する。

モデルを選ぶ。

プロンプトを調整する。

生成結果を保存する。

前回の素材を探す。

もう一度、別のモデルで試す。

この“つなぎ”の作業を人間が担っていたことが、AI制作の大きなボトルネックでした。

Higgsfield MCPは、その“つなぎ”をAI側に寄せる

Higgsfield MCPで変わるのは、まさにこの部分です。

ClaudeやClaude CodeなどのAIエージェントから、Higgsfieldの画像生成・動画生成・キャラクター制作・過去生成物の参照を直接呼び出せるようになります。

たとえば、こんな指示が現実的になります。

この商品の特徴を整理して、Instagram広告向けの動画案を3つ作って。

一番反応が良さそうな案で、縦型動画とサムネイル画像を作って。

さらに、別のモデルでも同じプロンプトを試して比較して。

ここで重要なのは、「画像や動画が作れる」ことだけではありません。

AIが制作の流れを理解し、そのままツールを動かせるようになることです。

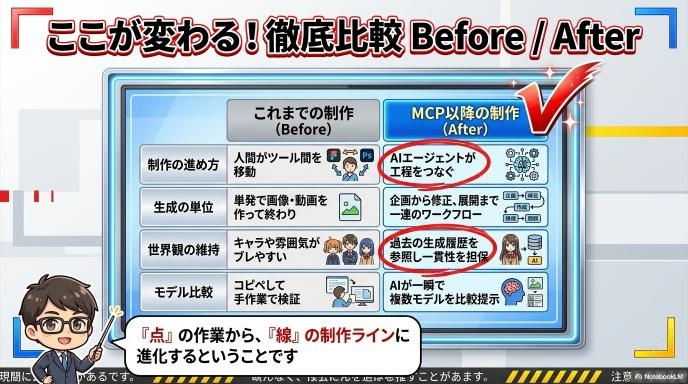

Before / Afterで見る制作フローの変化

| これまでの制作フロー | Higgsfield MCP以降の制作フロー |

|---|---|

| AIに企画を考えさせる | AIに企画から生成指示まで任せやすくなる |

| 画像生成ツールを別で開く | Claudeなどの会話内から画像生成を呼び出せる |

| 動画生成ツールを別で開く | 会話内から動画生成まで進められる |

| 生成物を手動で保存・再利用する | 過去の生成物を参照して次の制作に使いやすくなる |

| モデルごとに手作業で試す | 複数モデルを比較しやすくなる |

| 人間がツール間を移動する | AIエージェントが制作工程をつなぎやすくなる |

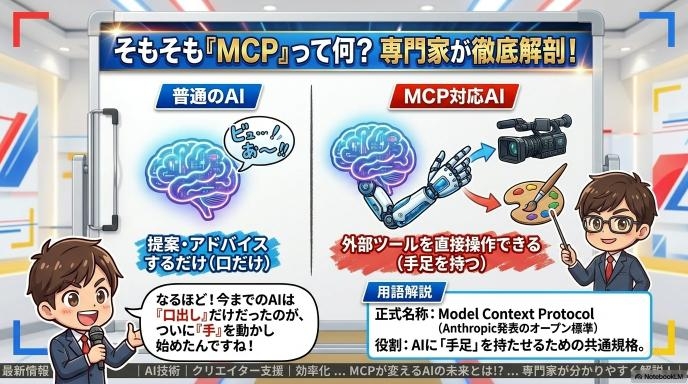

MCPは、AIに“手足”を持たせるための接続口

MCPは、AIに外部サービスを使わせるための仕組みです。

普通のAIは、基本的には会話の中で答えるだけです。

「こうした方がいいですよ」

「この案がよさそうです」

「このプロンプトを使ってください」

というところまではできます。

一方で、MCPに対応したAIは、外部ツールと接続することで、実際にツールを呼び出せるようになります。

つまりMCPは、AIに“手足”を持たせるための接続口です。

Higgsfield MCPの場合、その接続先が画像・動画制作ツールになります。

だから今回のニュースは、AIが文章でアドバイスするだけでなく、実際にクリエイティブ制作へ踏み込む話として注目されています。

正式名称はModel Context Protocol

MCPは Model Context Protocol の略です。

一部の投稿では「Model Connector Protocol」と書かれていることがありますが、正式には Model Context Protocol です。

AnthropicはMCPを、AIアシスタントと外部のデータソース、業務ツール、開発環境を接続するためのオープン標準として発表しています。

簡単に言えば、MCPはAIに外部サービスを使わせるための共通規格です。

普通のAIは答えるだけ、MCP対応AIは動ける

普通のAIは、会話の中で提案できます。

たとえば、広告案を考える。

動画の構成を提案する。

画像生成用のプロンプトを書く。

投稿文を作る。

しかし、その先の操作は人間が行う必要があります。

MCP対応AIは、ここが違います。

外部ツールと接続することで、AIがそのツールを呼び出せるようになります。

Claude Codeの公式ドキュメントでも、MCPによってClaude Codeが外部ツール、データベース、APIに接続でき、接続後は外部システムを直接読み取り・操作できると説明されています。

Higgsfield MCPは、制作ツールをAIの手元に置く

Higgsfield MCPは、このMCPの接続先がクリエイティブ制作ツールになったものです。

Higgsfield公式ページでは、1つの接続で画像生成、動画作成、キャラクター学習、アセット管理を扱えると説明されています。

つまり、Claudeが企画や指示を考え、Higgsfieldが実際に画像や動画を作る。

この流れを、ひとつの会話の中に持ち込みやすくなるわけです。

Claudeがディレクター、Higgsfieldが制作スタジオになる

Higgsfield MCPを直感的に理解するなら、Claudeがディレクター、Higgsfieldが制作スタジオになるイメージです。

Claudeは企画を考える。

Higgsfieldは実際に画像や動画を作る。

生成結果を見ながら、Claudeが次の修正案を考える。

過去の生成物を参照しながら、同じキャラクターや世界観で展開する。

これまでは、人間が各ツールの間に入って作業していました。

しかしHiggsfield MCPでは、その一部をAIエージェント側に寄せられます。

これは単発の画像生成ではなく、制作ワークフローそのものをAIに近づける動きです。

企画から生成までが、ひとつの会話に近づく

Higgsfield MCPでは、AIとの会話の中で、企画から生成までをつなげやすくなります。

たとえば、広告動画を作る場合を考えてみます。

まずClaudeに商品の特徴を整理させる。

次に、広告の訴求軸を複数出させる。

その中から、ターゲットに合いそうな案を選ばせる。

Higgsfieldで画像や動画を生成する。

結果を見ながら、さらに修正案を出す。

この流れを、ひとつの会話の中で進めやすくなるのがポイントです。

キャラクターや世界観を“続けて作る”ことが重要になる

AI制作では、1回きれいな画像が出ても、次に同じ雰囲気で作れないことがよくあります。

キャラクターの顔が変わる。

服装が変わる。

世界観がずれる。

前回の動画とトーンが合わない。

これは、広告、漫画、ブランドコンテンツ、SNS運用ではかなり大きな問題です。

Higgsfield MCPでは、過去の生成物を参照して新しい制作に使えるため、単発生成ではなく、継続した制作ワークフローに寄せやすくなります。

“単発生成”と“制作ワークフロー”の違い

| 単発生成 | 制作ワークフロー |

|---|---|

| 画像や動画を1つ作って終わる | 企画、生成、比較、修正、展開まで続く |

| その場のプロンプト品質に依存する | 過去素材や生成履歴を活用できる |

| キャラや世界観がぶれやすい | 同じ方向性で展開しやすい |

| 手作業で管理する | エージェント経由で参照しやすくなる |

| 個人の試作に向く | 広告、SNS、EC、映像制作に向く |

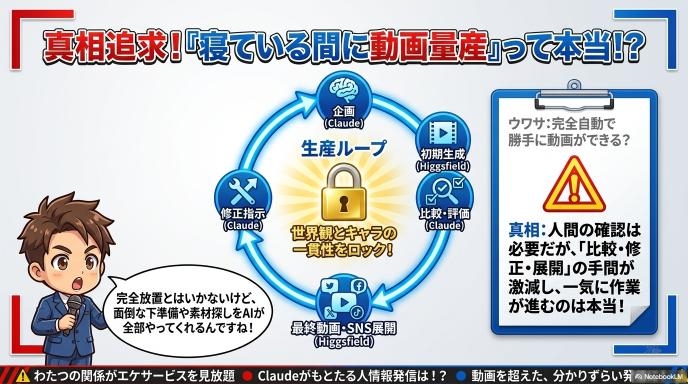

“寝ている間に動画が量産される”と言われる理由

今回の話題でよく見かけるのが、「寝ている間に動画が作られる」「自動でクリエイティブが量産される」という表現です。

これは少し誇張もあります。

ただ、なぜそう言われるのかは理解できます。

AIエージェントがHiggsfieldを直接使えるようになると、人間が毎回ツールを開いて操作する必要が減ります。

商品説明を読ませる。

広告案を作らせる。

画像を生成する。

動画に展開する。

複数案を比較する。

よさそうな方向に寄せて再生成する。

こうした一連の作業を、会話ベースでつなげやすくなります。

つまり「寝ている間に全部完成する」というより、正確には、人間が細かい操作をしなくても、AIが制作工程をまとめて進めやすくなるということです。

自動化のイメージが、クリエイターに刺さっている

クリエイターやマーケターが反応しているのは、「高品質な画像や動画が出る」だけではありません。

制作の流れをまとめて任せられるかもしれない。

素材の展開が早くなるかもしれない。

複数案の比較が楽になるかもしれない。

広告やSNS用の素材を量産しやすくなるかもしれない。

こうした期待があるから、話題になっています。

特に、日々の投稿や広告素材を大量に作る人にとっては、制作の手数が減ること自体が大きな価値になります。

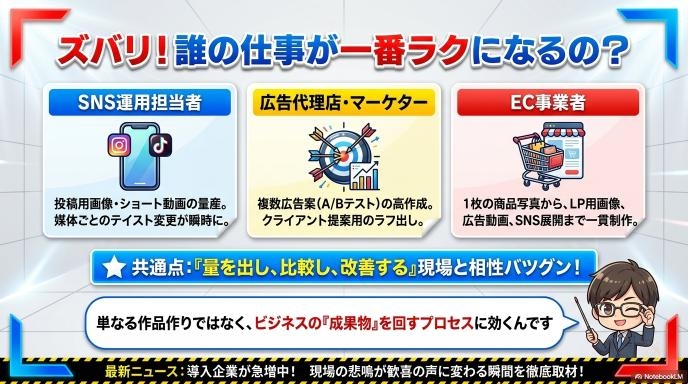

広告・SNS・ECでは、量を出せること自体が強い

広告クリエイティブでは、1つの完璧な案を作るより、複数案を出して試すことが重要です。

SNSでは、継続的に投稿できる素材量が必要です。

ECでは、商品写真をもとに、広告、LP、SNS、動画へ展開する必要があります。

Higgsfield MCPは、こうした「量を出し、比較し、改善する」制作と相性がよい仕組みです。

どんな人の仕事に効きやすいのか

| 対象 | 使い道 |

|---|---|

| SNS運用者 | 投稿用画像、ショート動画、キャンペーン素材の作成 |

| 広告代理店 | 複数広告案の作成、A/Bテスト用素材の展開 |

| EC事業者 | 商品写真やURLから広告動画・LP素材を作成 |

| 漫画・キャラ制作者 | キャラクターを画像、動画、SNS素材へ展開 |

| 映像制作者 | 絵コンテ、プリビズ、ルック検証 |

| 個人クリエイター | 少人数でのコンテンツ量産、世界観の展開 |

| 企業マーケ担当 | キャンペーン素材の初期案作成、社内検討用ラフ制作 |

30以上のモデルより大事なのは、“選ぶ・試す・比べる”手間が減ること

AI動画やAI画像を使い込んでいる人ほど、モデル選びの面倒さを知っています。

あるモデルは実写が強い。

あるモデルはキャラクターの雰囲気がいい。

あるモデルは動きが自然。

あるモデルは広告っぽい質感が出やすい。

あるモデルはプロンプトへの忠実度が高い。

つまり、モデルが多いこと自体は便利ですが、同時に選択の負担も増えます。

Higgsfield MCPの面白いところは、複数モデルを1つの導線で扱える点です。

同じプロンプトを複数モデルで試し、比較し、よさそうな方向に寄せていく。

この流れを作りやすくなることが、実務ではかなり大きな意味を持ちます。

モデルが増えるほど、選ぶ負担も増える

生成AIの世界では、モデル名が増えるほど一見便利になります。

しかし実際には、どのモデルを使えばよいのかを判断する必要があります。

実写風に強いのか。

アニメ寄りが得意なのか。

人物の破綻が少ないのか。

動きが自然なのか。

商品広告に向いているのか。

キャラクターの一貫性を保ちやすいのか。

詳しい人ほど、この比較に時間を使います。

“同じプロンプトで比較できる”ことが実務では強い

制作現場では、最初から正解のモデルを選べるとは限りません。

むしろ、同じプロンプトを複数モデルに投げて、出力を見比べた方が早いことも多いです。

広告素材なら、同じ訴求を複数の映像表現で試せます。

ブランドルックなら、世界観に合う質感を探せます。

キャラクターものなら、顔や雰囲気の安定感を比較できます。

Higgsfield MCPの価値は、モデルの数ではなく、モデルを制作工程の中で扱いやすくすることにあります。

モデル数の多さが価値になる場面

| 場面 | モデルを複数使える価値 |

|---|---|

| 広告案の比較 | 同じ訴求を複数の映像表現で試せる |

| ブランドルック検証 | 世界観に合う質感を探しやすい |

| キャラ制作 | 顔、服装、雰囲気の安定感を比較できる |

| 動画制作 | 動き、構図、カメラ感の違いを見られる |

| SNS投稿 | 媒体ごとに違うテイストを作りやすい |

| クライアント提案 | 初期案を複数提示しやすい |

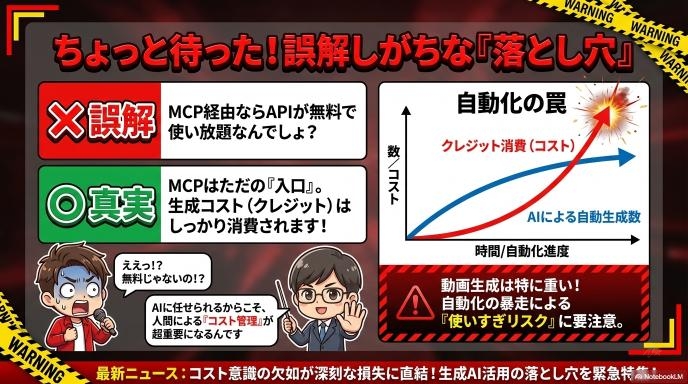

ただし、“無制限にAPIが使える”という話ではない

ここはかなり重要です。

SNS上では、「サブスク範囲内で全部回せる」「APIのように使える」といった表現が見られます。

ただし、実務で導入するなら、この点は慎重に見る必要があります。

Higgsfield公式FAQでは、MCP経由の利用もHiggsfield本体と同じクレジットシステムを使い、生成ごとにモデルや解像度に応じてクレジットを消費すると説明されています。

つまり正確には、APIキーを管理せずにエージェントから呼び出せるが、生成コストはクレジット制に従うということです。

「MCPで使える」ことと、「無料で無制限に使える」ことは別です。

MCPは入口であって、無料化の仕組みではない

MCPは、AIと外部ツールを接続する仕組みです。

そのため、MCPに対応したからといって、利用料金やクレジット消費がなくなるわけではありません。

Higgsfield MCPの場合も、Higgsfield側のプランやクレジット設計を確認する必要があります。

特に動画生成は、画像生成よりもコストが大きくなりやすい領域です。

自動化できるようになるほど、使いすぎのリスクも出てきます。

自動化するほど、コスト管理は重要になる

AIエージェントに大量生成を任せた場合、意図せず多くのクレジットを消費する可能性があります。

たとえば、複数モデルで比較する。

同じ広告案を何パターンも生成する。

動画を何度も作り直す。

解像度を上げる。

尺を伸ばす。

こうした操作は、制作上は便利ですが、コストにも直結します。

そのため、実務で使う場合は、生成前の確認、上限管理、チーム内のルールづくりが必要になります。

期待できることと、先に潰しておきたい誤解

| 期待できること | 注意すべきこと |

|---|---|

| 制作工程の一部をAIエージェントに任せられる | 完全自動で公開品質になるわけではない |

| 画像・動画・キャラ制作を一連の流れで扱いやすい | 生成物の品質確認は人間が必要 |

| 複数モデルを試しやすい | モデルごとの得意不得意は検証が必要 |

| 少人数でも多くの案を出せる | クレジット消費やコスト管理が必要 |

| SNS・広告・EC制作に活用しやすい | 商用利用条件や権利確認が必要 |

| 制作スピードが上がる | MCP接続時の権限管理・セキュリティ確認が必要 |

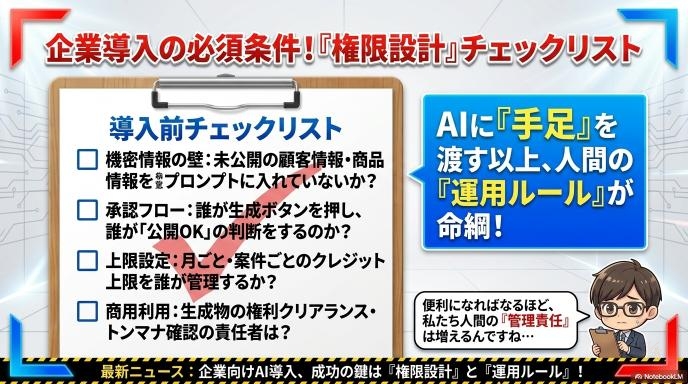

実務で使う前に、ここだけは確認しておきたい

Higgsfield MCPは魅力的ですが、実務で使うなら、最初に見るべきなのは「どのモデルが使えるか」だけではありません。

むしろ重要なのは、どう運用するかです。

誰が接続するのか。

誰が生成するのか。

誰が公開判断をするのか。

クレジット消費をどう管理するのか。

未公開情報や顧客情報を入れてよいのか。

生成物の商用利用条件を誰が確認するのか。

AI制作が便利になるほど、制作スピードだけでなく、運用設計も重要になります。

まず見るべきは、対応モデルより運用ルール

対応モデルの多さは魅力です。

しかし、実務利用ではそれ以上に、運用ルールが重要になります。

たとえば、広告代理店で使うなら、クライアント情報をどこまで入力してよいのかを決める必要があります。

企業のマーケティング部門で使うなら、誰が生成して、誰が公開判断をするのかを決める必要があります。

チームで使うなら、クレジット消費の上限や承認フローも必要になります。

便利なツールほど、最初のルール設計が後から効いてきます。

Claude WebとClaude Codeで使い方が変わる可能性もある

Higgsfield MCPは、ClaudeやClaude CodeなどのMCP対応クライアントから使えるとされています。

ただし、実際の使い勝手は、どのクライアントから使うかによって変わる可能性があります。

Claude Webで使う場合は、会話ベースのクリエイティブ生成が中心になるでしょう。

Claude Codeで使う場合は、制作フローやファイル管理、ワークスペース管理と組み合わせた使い方が想定されます。

導入前には、自分たちの業務に近い環境で試すことが重要です。

導入前チェックリスト

| チェック項目 | 確認する理由 |

|---|---|

| クレジット消費量 | 動画生成はコストが大きくなりやすい |

| 商用利用条件 | 広告・SNS・クライアントワークで使うため |

| 対応モデル | 使いたい画像・動画モデルが含まれているか確認するため |

| Claude Web / Claude Codeでの動作差 | 利用環境によってできることが変わる可能性があるため |

| 生成履歴の扱い | 過去素材を再利用できるか確認するため |

| チーム権限 | 誰が生成・接続・管理できるかを決めるため |

| セキュリティ | 未公開情報や顧客情報を扱う場合に必要なため |

| 公開前チェック | AI生成物をそのまま公開しないため |

| コスト上限 | 自動生成による使いすぎを防ぐため |

MCP時代は、便利さと同じくらい権限設計が大事になる

MCPは便利ですが、外部ツールをAIに使わせる仕組みである以上、セキュリティ面の注意も必要です。

AIが外部サービスを操作できるようになるほど、どこまで許可するのか、何を入力してよいのか、どの情報を扱わせるのかを決める必要があります。

Higgsfield MCPに限らず、MCP全般に言えることとして、権限設計やプロンプトインジェクションへの注意は避けて通れません。

便利さだけを見ると「AIに全部任せられる」と考えたくなりますが、実務ではそう単純ではありません。

むしろ、AIに任せる範囲が広がるほど、人間側の管理が重要になります。

外部ツールをAIに触らせる以上、接続先は選ぶ必要がある

MCPは、AIに外部ツールを使わせるための仕組みです。

そのため、接続先の信頼性は重要です。

どのMCPサーバーを使うのか。

どの権限を与えるのか。

どの情報を読み取れるようにするのか。

何を実行できるようにするのか。

ここを曖昧にしたまま使うと、便利さ以上のリスクが出てきます。

未公開情報や顧客情報の扱いは慎重にする

企業や代理店が使う場合、未公開の商品情報、顧客情報、広告戦略、キャンペーン前の素材などを扱う可能性があります。

こうした情報をAIエージェントや外部ツールに渡してよいのかは、事前に確認が必要です。

特に、クライアントワークで使う場合は、契約や利用規約、社内ルールとの整合性を確認しておくべきです。

企業利用では、承認フローと上限設定がほぼ必須になる

AIエージェントが制作を進められるようになると、生成スピードは上がります。

しかし、生成スピードが上がるほど、確認漏れや使いすぎも起こりやすくなります。

そのため企業利用では、少なくとも次のようなルールが必要になります。

| 管理項目 | 具体的に決めること |

|---|---|

| 生成権限 | 誰がHiggsfield MCPを使えるか |

| 公開判断 | 生成物を誰が確認して公開するか |

| クレジット上限 | 月ごと・案件ごとの利用上限をどうするか |

| 入力情報 | 未公開情報や顧客情報を入れてよいか |

| 商用利用確認 | 生成物を広告や納品物に使えるか |

| ログ管理 | 誰が何を生成したか追えるか |

| ブランドチェック | トンマナや権利面を誰が確認するか |

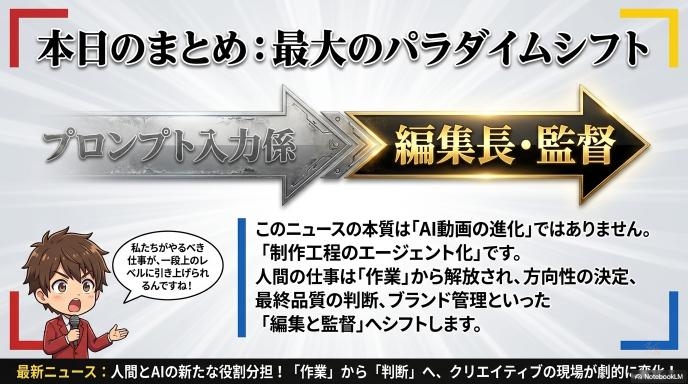

このニュースの本質は、AI動画の進化ではなく“制作工程のエージェント化”

Higgsfield MCPの話題を、単に「AI動画がまた進化した」と見ると少し浅いかもしれません。

もちろん、画像や動画の生成品質は重要です。

使えるモデルが多いことも魅力です。

Claude Codeなどから呼び出せることも便利です。

しかし、一番大きな変化は、制作工程そのものがAIエージェントに組み込まれていくことです。

これまでの生成AIは、単発の道具として使われることが多くありました。

画像を1枚作る。

動画を1本作る。

文章を1本書く。

しかしこれからは、企画、生成、比較、修正、再利用、展開までを、AIエージェントがつないでいく方向に進みます。

生成AIは、単発ツールから制作ラインに変わっている

生成AIは、最初は「何かを1つ作るツール」として使われていました。

1枚の画像を作る。

1本の文章を書く。

1本の動画を作る。

しかし実務で必要なのは、単発の生成だけではありません。

企画を出す。

複数案を作る。

比較する。

修正する。

媒体ごとに展開する。

過去素材を再利用する。

ブランドに合っているか確認する。

Higgsfield MCPは、こうした制作ラインにAIエージェントを入れやすくする動きです。

人間はプロンプト担当ではなく、編集長・監督・プロデューサーになる

AIが制作工程を進めやすくなると、人間の役割は変わります。

プロンプトを1回ずつ入力する人ではなく、方向性を決める人になる。

どの案を採用するか判断する人になる。

ブランドとして問題ないか確認する人になる。

最終的な品質を管理する人になる。

つまり、人間の仕事は、作業そのものから、判断と編集に寄っていきます。

Higgsfield MCPは、その変化が見えやすい象徴的なニュース

Higgsfield MCPが話題になっているのは、画像や動画の生成品質だけが理由ではありません。

ClaudeなどのAIエージェントから、クリエイティブ制作ツールを直接扱える。

複数モデルを試せる。

過去の生成物を参照できる。

広告やSNS、EC向けの素材制作に展開しやすい。

こうした要素がまとまっているからこそ、制作工程の変化を感じやすいニュースになっています。

まとめ:変わること、まだ変わらないこと

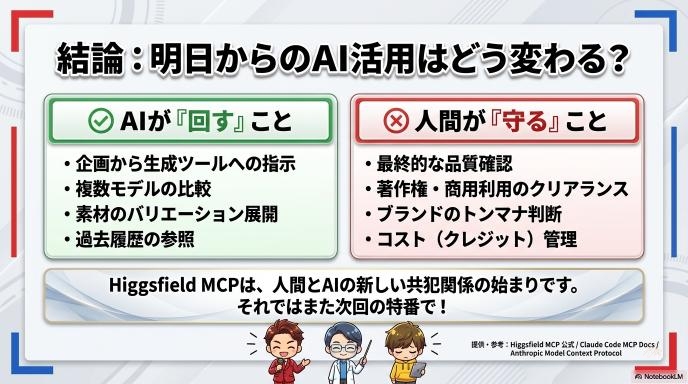

Higgsfield MCPで変わるのは、AIがクリエイティブ制作ツールを直接使えるようになることです。

ClaudeなどのAIエージェントから、Higgsfieldの画像生成、動画生成、キャラクター学習、生成履歴の参照、複数モデル比較ができるようになる。

これは、制作の流れをかなり変える可能性があります。

一方で、まだ変わらないこともあります。

生成物の品質を判断するのは人間です。

商用利用や権利関係を確認するのも人間です。

ブランドに合っているかを見るのも人間です。

コストやクレジット消費を管理するのも人間です。

だから、このニュースを一言でまとめるなら、こうです。

Higgsfield MCPは、“AIに画像や動画を作らせる”話ではなく、“AIに制作工程を回させる”話である。

そこに、多くのクリエイターやAI活用者が反応しているのです。

Higgsfield MCPで変わること

| 変わること | 内容 |

|---|---|

| 制作の入口 | AIとの会話から画像・動画生成へ進みやすくなる |

| ツール操作 | 人間が別ツールを行き来する手間が減る |

| モデル比較 | 複数モデルを試しやすくなる |

| 素材展開 | 画像、動画、広告、SNS素材へ展開しやすくなる |

| 制作体制 | 少人数でも多くの案を試しやすくなる |

まだ人間が見るべきこと

| 人間が見るべきこと | 理由 |

|---|---|

| 品質確認 | 生成物がそのまま公開品質とは限らない |

| 権利確認 | 商用利用や著作権・肖像権の確認が必要 |

| ブランド整合性 | トンマナや世界観がずれる可能性がある |

| コスト管理 | 自動生成でクレジット消費が増える可能性がある |

| 公開判断 | 最終責任は人間側に残る |

参考元URL一覧

- Higgsfield MCP公式ページ

https://higgsfield.ai/mcp - Higgsfield AI Video Generator公式ページ

https://higgsfield.ai/ai-video - Claude Code MCP公式ドキュメント

https://code.claude.com/docs/en/mcp - Anthropic「Introducing the Model Context Protocol」

https://www.anthropic.com/news/model-context-protocol - Model Context Protocol公式イントロ

https://modelcontextprotocol.io/docs/getting-started/intro - Model Context Protocol Security Best Practices

https://modelcontextprotocol.io/docs/tutorials/security/security_best_practices

コメント